Vol.125-2

本連載では、ジャーナリスト・西田宗千佳氏がデジタル業界の最新動向をレポートする。今回のテーマはマイクロソフトが発表した検索エンジン「Bing」の進化。マイクロソフトはなぜ生成系AIを検索に取り入れるのかを探る。

生成系(ジェネレーティブ)AIが、急速に進歩している。本記事を書いているタイミングでも進化し続けていて、話が古くなるのが多少怖い部分もある。

現在の生成系AIの核になっているのは「大規模言語モデル」と呼ばれる存在だ。大量のソースを集め、そこから学習を進めていくわけだが、OpenAIの「GPT-3」以降の、特に巨大な言語モデルによっていきなりフェーズが変わった。人間が描くのに近い映像が作れて、人間が話すのに近い言葉を生み出せてしまったわけだ。

「AIは英語や中国語などの、利用量が多い言語に有利。日本語向けのサービスはなかなか生まれない」

そんな言説が当たり前のように伝えられてきたが、GPT-3・GPT-4では、日本語でも同じように使えてしまっている。日本では見つからないような話題でも、「この話について日本語で説明して」とプロンプトに付け加えるだけで、ちゃんと日本語で答えが出てくるようになった。

結果として、従来のネット検索がもっていた特質は、生成系AI・大規模言語モデルの登場によって劇的に変わってしまった。

ただ、そうした本質的な技術変化は、本当に“使える”ツールに盛り込む必要がある。大規模言語モデルは、さまざまなやり方で人をサポートすることができる。過去のデータをまとめて見やすく提示することもできれば、長い文書を短く要約してもくれる。人と対話する「チャットボット」の技術として使うこともできれば、物語を作ってもらうことだってできる。

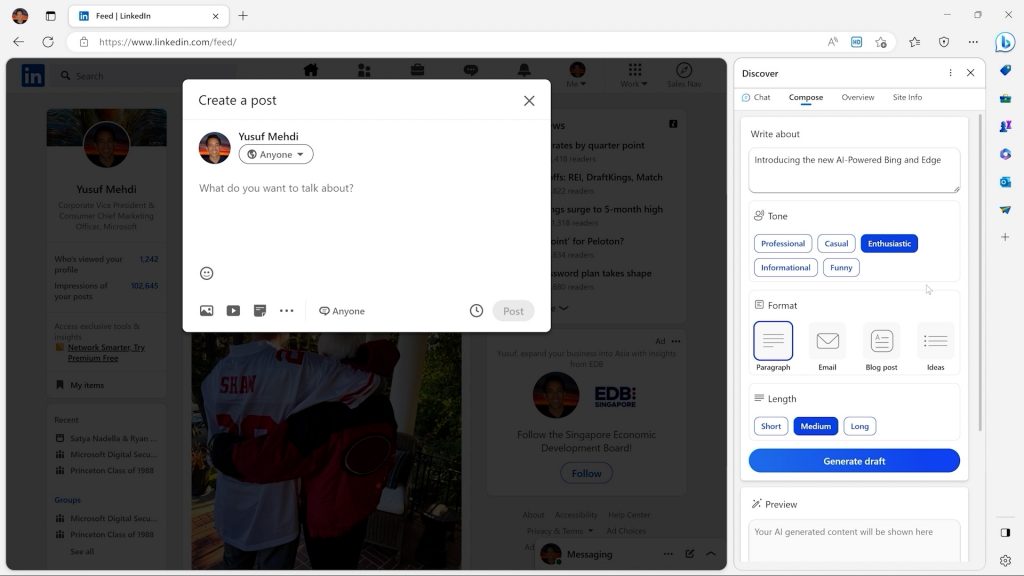

マイクロソフトが「検索」で新しいBingを導入したのは、簡単に言えば、検索というサービスがもっている特質を考えると、GPT-3やGPT-4のもっている、答えを出してくれるように「見える」要素だけでは足りないからでもある。前回解説したように、Bingのチャット検索は、検索に必要な「ソースがなにかを示す」「最新の情報をピックアップする」という機能を盛り込んでいる。そこをマイクロソフトが「Prometheus」という独自機能として作っているが、それでも、コアにあるジェネレーティブAIは「GPT-4」であったりする。

もう少し別の言い方をすれば、OpenAIが作った大規模言語モデルを「人をサポートするツール」として使うときに、検索のためにカスタマイズしたのが「新しいBing」である、ということになるだろう。

一方で、「特別な道具としての使い分けなどいらないのかもしれない」という予感もある。とにかくプロンプトに対して「やってほしいこと」を投げれば、それに相応しいアプリケーションが呼び出され、活用される可能性もあるだろう。

「AIがCo-pilot(副操縦士)になる」と、マイクロソフトやアドビなどは表現している。その理由は、特定のツールに分離しているのは一時的な姿で、結局はひとつのユーザーをサポートする「相手」になるのでは……というビジョンに基づいている。

マイクロソフトとOpenAIが、現在の「ジェネレーティブAI旋風」の中心にいるのは間違いない。

ではGoogleはどうするのか? 彼らの作っている「Bard」はどんなものになっているのか? 次回はその点を解説する。

週刊GetNavi、バックナンバーはこちら