米グーグルは「Google レンズ」にて、テキストと画像を同時に使って検索する「マルチサーチ」機能の追加を発表しました。

Google レンズは人工知能の一種である「ニューラル・エンジン」を利用した画像認識機能。カメラを向けた先や読み込んだ画像の内容を判別し、その内容をコピーして翻訳したり、検索したり、あるいは電話をかけたりするなどの操作ができます。

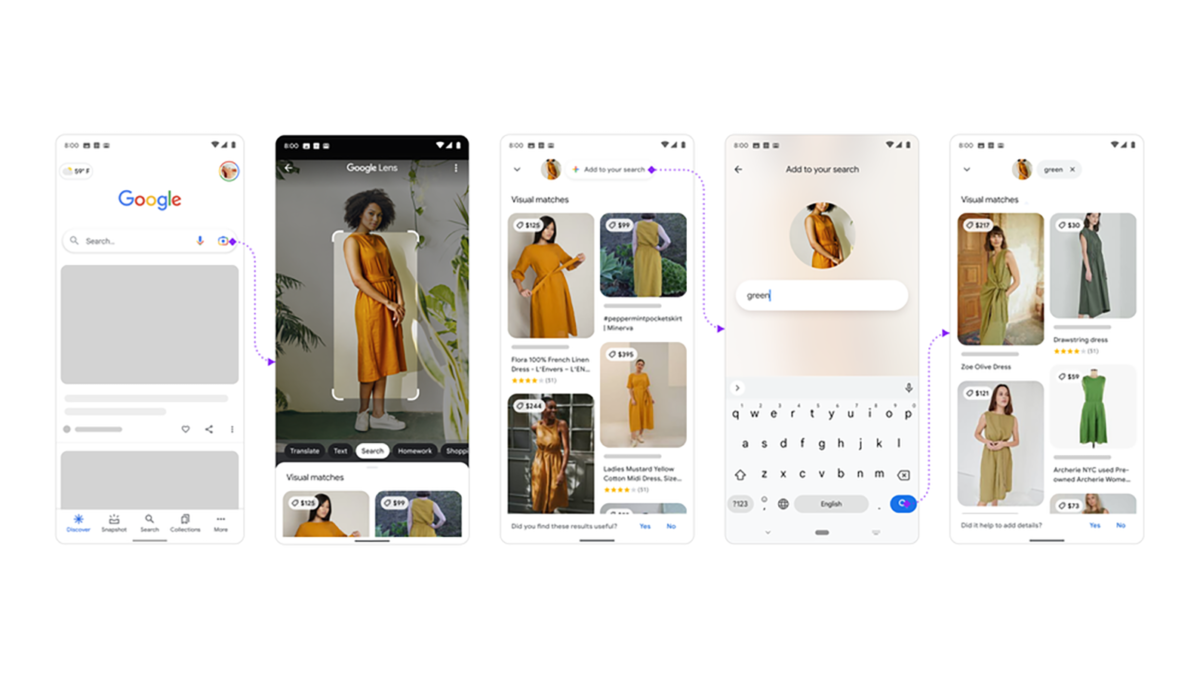

Google レンズのマルチサーチでは、まずカメラでのスナップ写真ショットやスクリーンショット画像を選択。それにテキスト入力によるワードを追加することで、画像と文字による同時検索が可能になります。

マルチサーチのメリットとしては、目の前のものについて質問できるほか、色やブランド、視覚的な属性で絞り込んで検索することができる点です。例えばオレンジ色の服をスクリーンショットで読み込み、「グリーン」という文字を追加すれば、形が似ているけど別の色の服を探すことができます。

米グーグルによると、この機能は人工知能の進歩、特にMUM(検索における最新AIモデル)による人工知能の強化によって実現しました。

Google レンズのマルチサーチはアメリカ/英語環境におけるベータ版機能として提供されます。動物などの自然や、商品検索などに特に役立ちそうな同機能、日本での機能リリースも期待したいものです。

Source/Image: グーグル