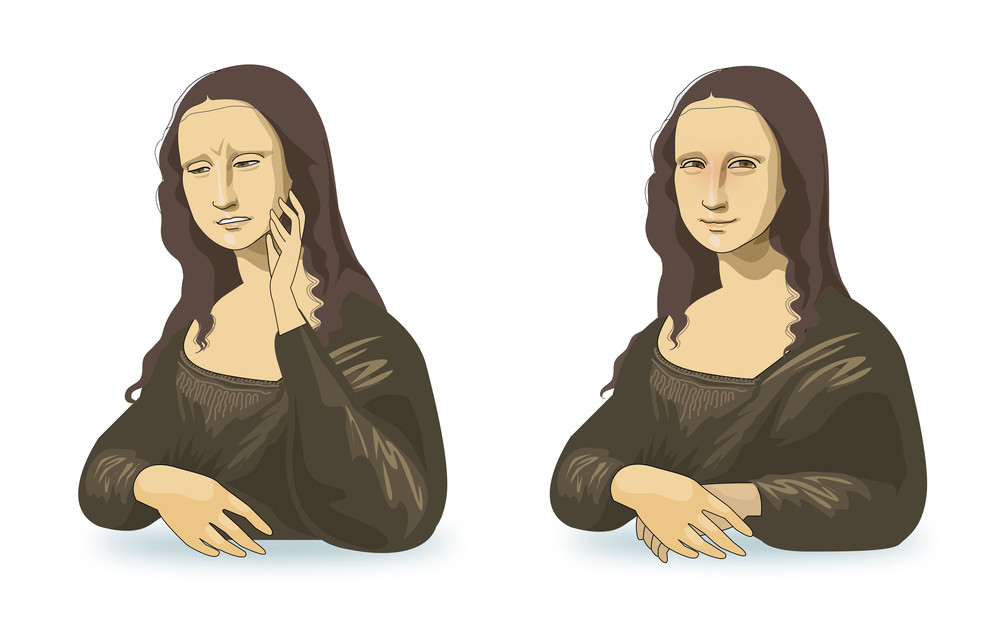

レオナルド・ダビンチの絵画「モナリザ」が、まるで生きている女性のように表情豊かに話しだした……。

世界中の人々が驚き、思わず二度見してしまったのが、そんなモナリザに命を吹き込んだAI技術です。サムスンAIセンター・モスクワの研究者たちが発表した、顔の静止画から人が話している動画を作る技術とは一体どんなものなのでしょうか?

動画データを長時間にわたってメタ学習

これまでにも、人が話したり笑ったりする表情を作る技術はありましたが、そのためには同じ人物の表情に関する大量のデータを機械が学習することが必要でした。しかし、サムスンAIセンター・モスクワの研究者たちが発表したこの方法では、ある人物の静止画像がたった1枚あれば、その人があたかも話しているような動画を作れてしまうのです。

なぜそんなことが可能なのかというと、膨大な量の動画データを長時間にわたりメタ学習(機械学習においてアルゴリズムが学習方法を学ぶこと)させ、初めて見る人物の顔画像でも、その人の顔が動く動画を作れるようにしたから。データにはない人物の顔であっても、その人の表情がリアルに動くような顔モデルを生成することができるのです。

さらに、この新技術はGenerative Adversarial Network(GAN、敵対的生成ネットワーク)も使用。これにより、様々に生成された顔モデルを互いに比較して、よりリアルなモデルを生成します。だから、モナリザのほかにもアインシュタインやマリリンモンローなど、もうこの世には存在しない人物であっても、同じように顔を写した1枚の画像があれば、そこから話している動画を作成できるんですね。

心配なのはディープフェイク

サムスンAIセンター・モスクワでは、この技術はビデオ会議やゲームなどでも活用できると述べていますが、一方では「ディープフェイク」の問題も無視できないとする声があがっています。

ディープフェイクとは、画像や動画の一部を勝手に別人に入れ替えたりする技術のこと。米バージニア州ではリベンジポルノを禁止する法案がありますが、これにディープフェイクも対象とするという文言が追加されています。

今回の動画生成技術がさらに進めば、本人が言ってもいないことでも第三者によって勝手に動画として作られてしまう恐れもあるわけです。

画像の世界では、すでに修正することが当たり前になり、修正の有無すら見分けがつかなくなるほど技術が進んでいます。それと同様のことが動画でも起きており、テクノロジーへの期待が膨らむと同時に倫理的課題も生じています。